Métodos neurocientíficos para hacer que robots parezcan más sociales, ¿es posible?

Personas antropomorfizan y tratan a robots cual si fueran agentes intencionales, mas ello está lejos de tratarlos como compañeros sociales

¿Es posibleusar métodos neurocientíficos para hacer a los robots parecer más sociales y así sean mejor aceptados por las personas? Entretenimiento, enseñanza y atención médica son áreas donde los robots pueden ayudar a los humanos; pero, antes que nada, estos deben aceptar a los primeros como asistentes: el público en general puede ser muy escéptico con respecto a la introducción de asistentes robóticos en la vida cotidiana. Aquí entra la robótica social, en el estudio de los mecanismos que llevan a los humanos a concebir a los robots como compañeros sociales.

Según señalan investigadores adscritos a la Universidad de Potsdam(Alemania), atribuir intencionalidad es el mecanismo clave para tratar a los demás como compañeros sociales: "Cuando le atribuimos intencionalidad a alguien, le damos sentido a sus acciones, lo tratamos como criatura con una mente con el poder de 'ser, representar o defender cosas, propiedades y estados de cosas'. Por lo tanto, atribuir intencionalidad a alguien es una actividad altamente compleja. Implica tener creencias sobre las creencias de alguien más".

Para comprender el mecanismo de atribución de intencionalidad, hay dos aspectos a considerar: el sujeto que atribuye la intencionalidad y el objeto en cuestión. Ahora bien, respecto al uso de métodos neurocientíficos para hacer a los robots parecer más sociales, explican los especialistas: "los pensamientos no pueden observarse o percibirse únicamente mediante el examen de las propiedades del cerebro; las creencias no son reducibles a estados cerebrales". Es decir, no obstante observar el cerebro de un sujeto podría decirnos si atribuye intencionalidad a un objeto, no ayudará a explicar por qué o cómo lo hace.

#Tecnología | Un trabajo de 15 años resulta en el #robot Atlas, de Boston Dynamics. Ahí, haciendo parkour. pic.twitter.com/iTXS7wg6WY

— My Press (@mypress_mx) October 16, 2018

Los informes verbales (preguntas directas) son una manera fácil de detectar factores inhibidores en la aceptación de los robots como compañeros sociales, asimismo permiten encontrar razones por las cuales una persona podría o no tratar a un robot así. Por ejemplo, en una interacción humano-robotes fácil preguntar si el sujeto piensa que el objeto realmente tiene una mente; dicha información, conceptualmente, no puede ser transmitida por neuroimagen. Aunque los informes verbales son vitales para las preguntas relacionadas con la "percepción mental", se requiere un diseño experimental que incluya tanto neuroimagen como informes verbales.

Respecto a usar métodos neurocientíficos para hacer a los robots parecer más sociales, concluyen los especialistas en ciencia cognitiva: "Es al menos discutible si los robots tendrán o no alguna vez una mente verdaderamente intencional". Las personas antropomorfizan y tratan a los robots cual si fueran agentes intencionales, pero ello está lejos de tratar a alguien como un compañero social, precisan los investigadores. "El escepticismo restante puede inhibir la adopción de la postura intencional, incluso hacia robots de comportamiento perfecto; y así evitar que las personas traten a los robots sociales como verdaderos compañeros sociales", advierten.

TecnologíaRobotsCiencia

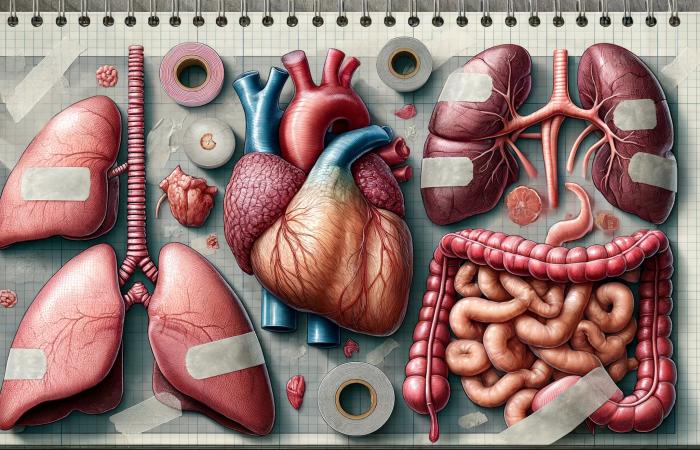

La escasez de donantes complica el acceso a trasplantes en México

La escasez de donantes complica el acceso a trasplantes en México Un estudio revela la relación entre la depresión y el deseo de alimentos dulces

Un estudio revela la relación entre la depresión y el deseo de alimentos dulces China presenta Manus, el primer agente de inteligencia artificial realmente autónomo

China presenta Manus, el primer agente de inteligencia artificial realmente autónomo Un estudio revela cómo mejorar la resistencia a la desinformación en línea

Un estudio revela cómo mejorar la resistencia a la desinformación en línea